A/B Testing — statistisch sauber, intern verteidigbar, ohne Redesign-Risiko. Wir testen mit echtem Traffic — bevor Sie sechsstellig in einen Relaunch investieren.

A/B-Testing ist eine der mächtigsten Methoden, um Websites und Online-Shops nachhaltig zu verbessern. Zwei Versionen einer Seite werden zufällig an unterschiedliche Nutzergruppen ausgespielt — und Sie sehen messbar, welche besser performt. Nicht in Theorie, sondern an echten Besucher:innen.

Aber Achtung: A/B-Testing ist nicht der Anfang Ihrer Optimierung. Es ist die Validierung von Hypothesen, die aus einer fundierten Analyse stammen. Ohne saubere Datenbasis testen Sie ins Blaue — und treffen am Ende Entscheidungen, die statistisch wertlos sind.

Deshalb starten wir bei jedem Mandat zuerst mit einer strukturierten Conversion-Analyse. Erst wenn klar ist, was getestet werden soll und warum, lohnt sich der Test.

Wir testen nicht nach Bauchgefühl. Wir testen nach Protokoll — damit Ihre Ergebnisse intern verteidigbar sind.

Jeder Test braucht eine konkrete, messbare Hypothese. Wir entwickeln sie auf Basis Ihrer Conversion-Analyse — nicht auf Basis von Annahmen.

Mindestens zwei Wochen. Saisonale Schwankungen, Wochentage und externe Effekte werden in der Planung berücksichtigt — nicht im Nachhinein hineininterpretiert.

Mindestens 500 Besucher:innen pro Variante. Bei kleineren Traffic-Volumen stimmen wir die Konfidenz-Schwelle und Testdauer entsprechend an — bevor wir starten, nicht währenddessen.

In unseren Live-Siteclinics entwickeln wir gemeinsam mit Ihnen Testkonzepte — kostenfrei, unverbindlich, mit konkreten Hypothesen, die Sie sofort umsetzen können.

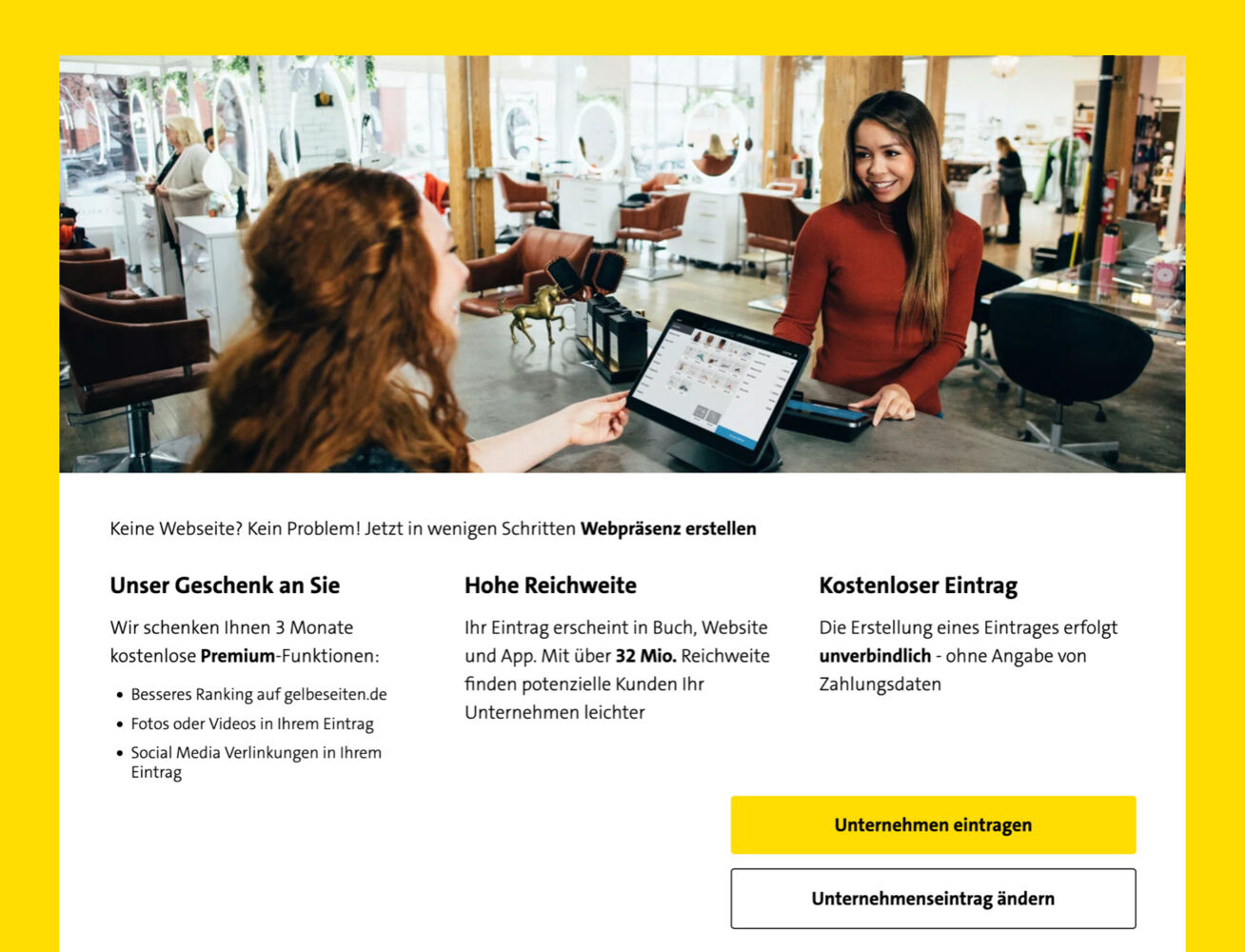

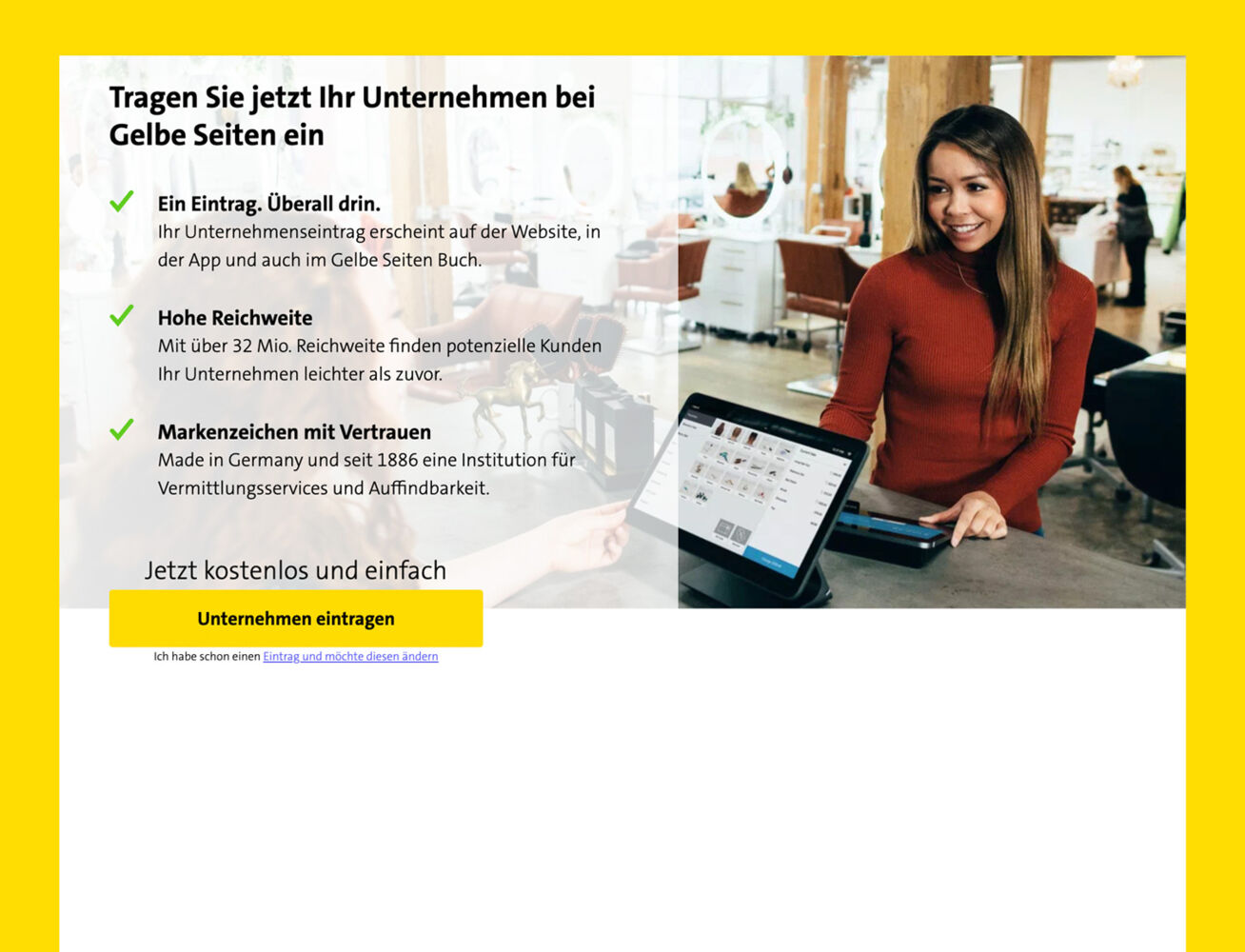

Ein Klassiker aus unserer Test-Praxis — und ein Beweis, wie viel Verhaltensökonomie auf Landingpages bewirken kann. Bei Gelbe Seiten haben wir den Gaze-Cueing-Effekt getestet: das psychologische Phänomen, dass Menschen unbewusst dem Blick anderer Menschen folgen.

Variante A zeigte ein Model, das frontal in die Kamera schaute. Variante B zeigte dasselbe Model — nur mit dem Blick auf den entscheidenden Call to Action gerichtet. Sonst nichts. Keine andere Änderung. Kein Redesign.

Das Ergebnis war eindeutig: Die Aufmerksamkeit der Besucher:innen wanderte deutlich häufiger auf den Button. Die Conversion-Rate stieg signifikant — und das Erlebnis blieb absolut natürlich.

Inkl. Hypothesen-Setup, Test-Aufbau, statistischer Auswertung und der vollständigen Begründung des Gaze-Cueing-Effekts. So können Sie den Test-Aufbau auf Ihre eigenen Landingpages übertragen.

Nicht jedes Setup ist reif für strukturierte Tests. Wir sind ehrlich, bevor wir starten.

Ihr Shop oder Ihre Website läuft stabil, Marketing-Kampagnen sind aktiv und liefern verlässlich Traffic. Ohne stabile Basis sind Tests verzerrt.

Tests brauchen Planung, Implementierung und Auswertung. Wir übernehmen das oder arbeiten mit Ihrem Team — wichtig ist, dass es jemand tut.

Gut durchdachte Hypothesen sind die Voraussetzung für aussagekräftige Tests. Sie kommen aus Ihrer Conversion-Analyse — nicht aus dem Workshop-Brainstorming.

Sieben Klassiker, die wir im Mittelstand immer wieder finden — und die jeden Test sabotieren.

Wenn Besucher:innen in 3 Sekunden nicht verstehen, was Sie anbieten, gewinnt jede Variante zu wenig.

Jedes zusätzliche Feld kostet messbar Conversion. Fragen Sie nur, was Sie wirklich brauchen.

Ein Call-to-Action muss gefunden, verstanden und vertraut werden. Sonst wird er ignoriert.

Das Versprechen Ihrer Anzeige muss sich auf der Landingpage einlösen. Sonst springen Besucher:innen sofort ab.

Jede zusätzliche Sekunde kostet Conversion. Performance ist die unsichtbarste, aber wichtigste UX-Disziplin.

Mehr als die Hälfte Ihres Traffics ist mobil. Mobile-Tests sind kein Bonus — sie sind Pflicht.

Drei Begriffe, die bei jedem A/B Test fallen — und die wir vor dem Start gemeinsam mit Ihnen durchrechnen, damit am Ende kein „nicht aussagekräftig" steht.

Die Anzahl Sessions, die Sie pro Variante brauchen, damit der Test überhaupt eine Chance hat, einen Effekt zu sehen. Hängt direkt an Ihrer Ausgangs-Conversion-Rate und am erwarteten Uplift. Bei 2 % Conversion und +10 % Ziel: rund 30.000 Sessions je Variante.

Der kleinste Unterschied zwischen A und B, den Ihr A/B Test bei gegebener Stichprobe sicher messen kann. Je kleiner die Veränderung — etwa ein Button-Text statt einer ganzen Page — desto höher der nötige MDE oder die nötige Laufzeit.

Die Wahrscheinlichkeit, dass der gemessene Uplift nicht zufällig ist. Branchen- und Gerichts-Standard sind 95 % Konfidenz. Erst dann gilt ein A/B Test bei uns als gewonnen — alles darunter ist Indiz, kein Beweis. Mehr im Glossar →

Ehrliche, unverklausulierte Antworten aus 20 Jahren Praxis im Mittelstand.

Beim A/B Testing wird der Traffic einer Seite per Zufallsprinzip auf zwei (oder mehr) Varianten aufgeteilt: Variante A ist die Kontrolle, Variante B die geänderte Version. Beide laufen gleichzeitig im selben Zeitraum, damit Saison- oder Wochentags-Effekte beide Varianten gleichermaßen treffen. Gemessen wird ein klar definiertes Conversion-Ziel — etwa Käufe, Anmeldungen oder Leads. Nach Erreichen der vorab berechneten Stichprobengröße wird statistisch geprüft, ob der Unterschied zwischen den Varianten signifikant ist (Branchenstandard: 95 % Konfidenz). Erst dann gilt der Test als entschieden und die Gewinner-Variante wird ausgerollt.

Sieben Schritte für einen sauberen A/B Test:

Wer einen dieser Schritte überspringt — vor allem 4 und 7 — produziert Pseudo-Ergebnisse.

Faustregel: bei einer Ausgangs-Conversion-Rate von 2–3 % und einer angestrebten relativen Verbesserung (MDE) von 10 % sind rund 20.000–40.000 Sessions pro Variante nötig, um auf 95 % Konfidenz zu kommen. Je kleiner der erwartete Uplift, desto größer die Stichprobe — wir berechnen die nötige Größe vor dem Start, damit am Ende kein „nicht aussagekräftig" steht.

Mindestens zwei volle Wochen, um Wochentag- und Saisoneffekte abzudecken. Die tatsächliche Laufzeit ergibt sich aus der nötigen Stichprobengröße geteilt durch den realen Tages-Traffic. Tests vorzeitig zu stoppen, weil eine Variante früh führt, ist der häufigste Fehler — die Konfidenz ist dann nicht erreicht und das Ergebnis statistisch wertlos.

Statistische Signifikanz beschreibt die Wahrscheinlichkeit, dass der gemessene Unterschied zwischen Variante A und B nicht zufällig ist. Branchenstandard sind 95 % Konfidenz: das heißt, in höchstens 5 von 100 Fällen wäre der gleiche Effekt auch ohne echten Unterschied messbar. Erst ab 95 % gilt ein Test bei uns als gewonnen — alles darunter ist Hypothese, kein Beweis.

Ein einzelner, sauber aufgesetzter Test (Hypothese, Implementierung, statistische Auswertung, Dokumentation) liegt typischerweise zwischen 2.500 und 6.000 € — abhängig von technischer Komplexität und Tooling. Sinnvoll wird A/B Testing aber erst als laufendes Programm: 6–8 Tests pro Jahr in einem Retainer von 3.500–7.000 € monatlich, inklusive vorgelagerter Conversion-Analyse.

Google Optimize war das kostenlose A/B-Testing- und Personalisierungs-Tool von Google, eng integriert in Google Analytics. Es wurde 2017 als Teil der Google-Marketing-Platform eingeführt und richtete sich vor allem an kleine und mittlere Websites, die ohne Budget einsteigen wollten. Am 30. September 2023 hat Google das Tool eingestellt — sowohl die kostenlose Variante (Optimize) als auch die Enterprise-Version (Optimize 360). Bestehende Tests wurden an dem Datum automatisch beendet.

Google Optimize bot vier Test-Typen: A/B-Tests (zwei Varianten gegeneinander), Multivariate Tests (mehrere Elemente in Kombination), Redirect-Tests (komplette URL-Wechsel) und Personalisierungen (dauerhafte Anpassungen für bestimmte Zielgruppen). Die Bedienung lief über einen visuellen WYSIWYG-Editor direkt im Browser, die Auswertung kam aus Google Analytics — inklusive Bayes-Statistik und Targeting-Optionen wie Geo, Device oder Custom-Audiences. Da das Tool seit September 2023 abgeschaltet ist, übernehmen heute Lösungen wie VWO, AB Tasty, Kameleoon oder GrowthBook diese Funktionen.

Google Optimize wurde im September 2023 eingestellt. Sinnvolle Alternativen für den Mittelstand: VWO (gutes Preis-Leistungs-Verhältnis, server-side möglich), AB Tasty (DSGVO-konform, EU-Hosting, starkes Personalisierungs-Modul), Kameleoon (Fokus auf KI-gestützte Personalisierung), Convert (datenschutzfreundlich, transparente Preise) oder GrowthBook (Open Source, self-hosted für maximale Datenkontrolle). Für reine Server-Side-Tests ohne UI-Tooling: LaunchDarkly oder Statsig. Welches Tool passt, hängt an Traffic-Volumen, Tracking-Setup und Datenschutz-Anforderungen — wir wählen das Tool im Erstgespräch passend zur Infrastruktur aus.

Für 90 % der Fälle im Mittelstand: A/B Test. Multivariate Tests (MVT) testen mehrere Elemente gleichzeitig in allen Kombinationen — das vervielfacht den Traffic-Bedarf und ist nur bei sehr hohem Volumen aussagekräftig. A/B Tests beantworten eine klare Hypothese sauber, schnell und intern verteidigbar.

Für die reine Test-Persistenz reicht ein technisch notwendiger First-Party-Cookie ohne Consent. Sobald aber personenbezogene Auswertung (z.B. via GA4 oder Marketing-Pixel) dazukommt, greift die DSGVO und ein Consent-Layer ist Pflicht. Wir setzen Tests so auf, dass die statistische Auswertung auch ohne Tracking-Consent funktioniert.

Kostenfrei. Unverbindlich. Konkret. Wir prüfen Ihren Funnel, identifizieren die Hebel mit dem höchsten Test-Potenzial — und sagen Ihnen ehrlich, ob A/B-Testing für Sie aktuell der richtige nächste Schritt ist.

Erstgespräch vereinbaren →